Nel 2020, il filosofo di Oxford Toby Ord ha pubblicato un libro intitolato The Precipice sul rischio di estinzione che corrono gli esseri umani. Secondo lui, la possibilità di una “catastrofe esistenziale” per la nostra specie nel corso di questo secolo è pari a una su sei.

È difficile non essere d’accordo con l’idea che nei prossimi decenni dovremo affrontare prospettive preoccupanti, dal cambiamento climatico, alle armi nucleari e agli agenti patogeni bioingegnerizzati, all’intelligenza artificiale canaglia a possibili impatti con grandi asteroidi.

Lanci di monete e previsioni del tempo

Per rispondere a queste domande, dobbiamo prima rispondere ad un’altra: cos’è la probabilità?

Oppure consideriamo il caso più complicato delle previsioni del tempo. Cosa significa quando un meteorologo ci dice che c’è una possibilità su sei (o il 17%) che piova domani? È difficile credere che il meteorologo voglia farci immaginare un vasto insieme di “domani”, di cui una parte avrà precipitazioni. Dobbiamo invece esaminare un gran numero di tali previsioni e vedere cosa è successo dopo di esse.

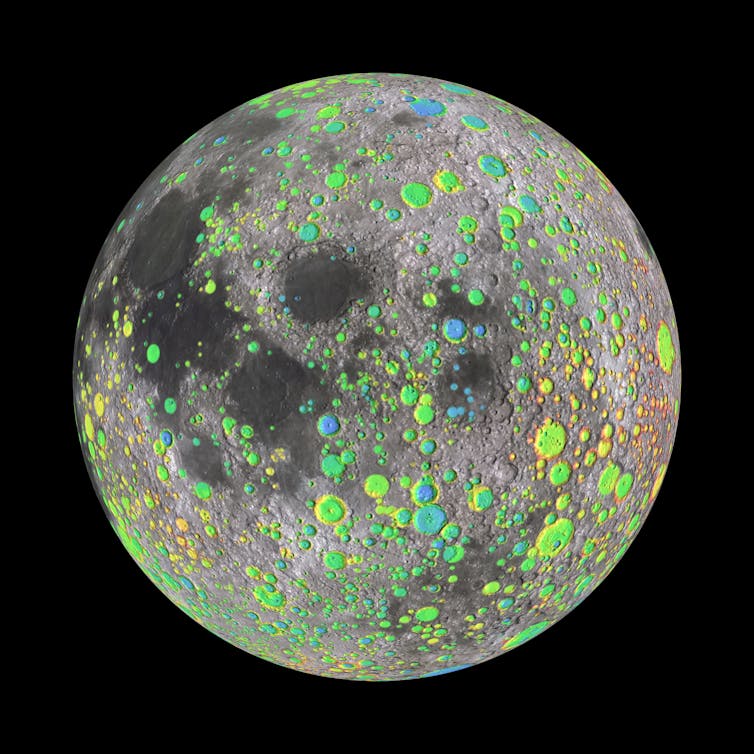

Possiamo imparare dalla Luna?

Cosa significa questo per la probabilità che l’umanità si estingua? Ebbene, un evento del genere sarebbe un caso unico: una volta accaduto, non ci sarebbe spazio per ripetizioni ma potremmo trovare alcuni eventi paralleli da cui imparare. Infatti, nel libro di Ord vengono discussi una serie di potenziali eventi di estinzione, alcuni dei quali possono essere potenzialmente esaminati alla luce di una storia.

Ad esempio, possiamo stimare le probabilità che un asteroide abbastanza grande da provocare un’estinzione di massa colpisca la Terra esaminando quante rocce spaziali di questo tipo hanno colpito la Luna nel corso della sua storia. Uno scienziato francese di nome Jean-Marc Salotti lo ha fatto nel 2022, calcolando che le probabilità di un impatto a livello di estinzione durante questo secolo sono circa una su 300 milioni.

Un sistema di classificazione per i risultati

Esiste un altro modo di pensare alla probabilità, chiamato bayesianesimo dal nome dello statistico inglese Thomas Bayes. Si concentra meno sugli eventi in sé e più su ciò che sappiamo, ci aspettiamo e crediamo al riguardo.

Il libro di Ord, ad esempio, contiene una tabella di potenziali eventi di estinzione e le sue stime personali della loro probabilità. Da una prospettiva bayesiana, possiamo vedere questi valori come ranghi relativi.

La difficoltà qui è che le stime iniziali delle probabilità bayesiane (spesso chiamate “a priori”) sono piuttosto soggettive. Il ragionamento bayesiano tradizionale si sposta da “a priori” a “posteriori” incorporando nuovamente prove osservative di risultati rilevanti per “aggiornare” i valori di probabilità.

Stime soggettive

Esistono due modi di pensare all’accuratezza e all’utilità dei calcoli di probabilità: calibrazione e discriminazione.

Non abbiamo le basi per ritenere che i valori di Ord siano adeguatamente calibrati. Naturalmente, non è probabile che questo sia il suo intento. Lui stesso indica che sono pensati per lo più per dare indicazioni di “ordine di grandezza”. Anche così, senza alcuna conferma osservativa, la maggior parte di queste stime rimangono semplicemente nel dominio soggettivo delle probabilità a priori.

Non ben calibrato, ma forse comunque utile

Allora cosa dobbiamo pensare di “uno su sei“? L’esperienza suggerisce che la maggior parte delle persone non ha una comprensione perfetta della probabilità. In questo ambiente, se stai discutendo in pubblico, una stima della “probabilità” non deve necessariamente essere ben calibrata, deve solo avere il giusto tipo di impatto psicologico.

Come persona preoccupata per il futuro, spero che rischi come il cambiamento climatico e la proliferazione nucleare ricevano l’attenzione che meritano. Ma come scienziato dei dati, spero che l’uso imprudente della probabilità venga lasciato nel dimenticatoio e sostituito da un’educazione diffusa sul suo vero significato e sull’uso appropriato.![]()

Steven Stern, professore di scienza dei dati, Bond University

Questo articolo è ripubblicato da The Conversation sotto una licenza Creative Commons. Leggi l’articolo originale.