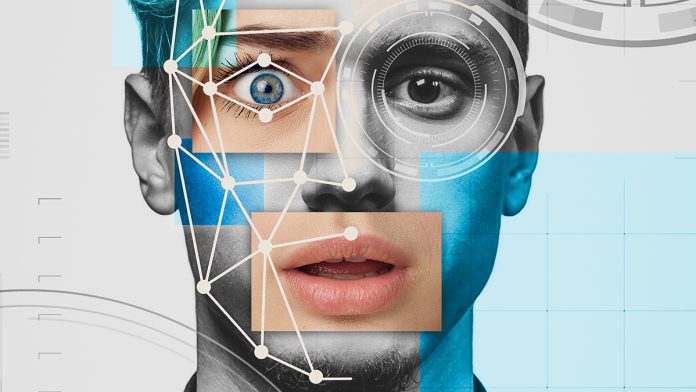

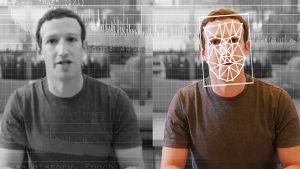

Il nuovo fenomeno dei deepfake che ha esordito sui social un po’ in sordina, inizialmente in modo divertente ma col crescere del fenomeno sempre più inquietante, sta iniziando ad agitare gli animi degli utenti, che non sanno più distinguere ciò che è reale da ciò che è costruito ad arte dall’intelligenza artificiale. Ma procediamo per ordine: che cos’è un deepfake?

Deepfake: di cosa si tratta e come funzionano?

I deepfake esistono dal 2014, quando Ian Goodfellow, studente presso l’Università di Montréal, (Oggi è ricercatore presso DeepMind, un laboratorio di ricerca sull’intelligenza artificiale gestito da Google) li ha inventati per la prima volta durante il suo dottorato di ricerca in machine learning. Per riuscire a svilupparli, ha ideato un modello di apprendimento automatico chiamato reti generative avversarie o GAN.

L’apprendimento automatico è un sottocampo dell’intelligenza artificiale focalizzato sulla creazione di algoritmi statistici in grado di eseguire attività senza istruzioni esplicite.

I deepfake sono immagini manipolate dall’AI che sviluppa contenuti convincenti ma che in realtà sono delle bufale. La definizione stessa chiarisce che che il contenuto fasullo risultante è una combinazione di deep learning e informazione falsa. Generalmente coinvolge brevi video che chiunque può creare, dando vita a temi del tutto inverosimili.

Insomma ci stanno togliendo tutte le certezze: se prima i format video erano la prova provata di un fatto realmente accaduto, oggi dobbiamo guardarci anche da questi, poiché potrebbero nascondere delle insidie. Aspetteremo il deepfake anche della nostra ombra, in modo da rendere ancora più solido il concetto di impermanenza, visto che, a quanto pare, le incertezze che la Vita ci offre, non sono più sufficienti a destabilizzarci.

I deepfake spesso trasformano i contenuti originali esistenti in cui una persona viene scambiata con un’altra. Creano anche contenuti del tutto originali in cui qualcuno viene rappresentato mentre fa o dice qualcosa che non ha fatto o detto.

Il pericolo maggiore rappresentato dai deepfake è la loro capacità di diffondere informazioni false che sembrano provenire da fonti attendibili. Ad esempio, nel 2022 è stato pubblicato un video deepfake del presidente ucraino Volodymyr Zelenskyy che chiedeva alle sue truppe di arrendersi.

Sono state inoltre sollevate preoccupazioni circa la possibilità di intromettersi nelle elezioni e nella propaganda elettorale.

Per completezza di informazione, è giusto precisare che i deepfake hanno anche usi legittimi, come l’audio e l’intrattenimento dei videogiochi, l’assistenza clienti e le applicazioni di risposta alle chiamante, come l’inoltro di chiamata e i servizi di receptionist.

Il deepfake sfrutta due algoritmi, un generatore e un discriminatore, per creare e perfezionare contenuti falsi. Il generatore costruisce un set di dati di addestramento in base all’output desiderato, creando il contenuto digitale falso iniziale, mentre il discriminatore analizza quanto sia realistica o falsa la versione iniziale del contenuto.

Questo processo viene ripetuto, consentendo al generatore di migliorare nella creazione di contenuti realistici e al discriminatore di diventare più abile nell’individuare difetti che il generatore può correggere.

La combinazione degli algoritmi generatore e discriminatore crea una rete avversaria generativa. Un GAN utilizza il deep learning per riconoscere modelli nelle immagini reali e quindi utilizza tali modelli per crearne falsi.

Nel momento in cui si dà vita ad una fotografia deepfake, un sistema GAN visualizza le fotografie del bersaglio da una serie di angolazioni per catturare tutti i dettagli e le prospettive. Quando si crea un video deepfake, il GAN visualizza il video da varie angolazioni e analizza anche il comportamento, i movimenti e i modelli di discorso. Queste informazioni vengono quindi eseguite più volte attraverso il discriminatore per ottimizzare il realismo dell’immagine o del video finale.

Il fenomeno tuttavia presenta un incremento allarmante: rispetto allo stesso periodo del 2022, nel 2023 sono stati pubblicati online tre volte più video deepfake e otto volte più deepfake vocali, secondo DeepMedia, una società che collabora con il Dipartimento della Difesa degli Stati Uniti, le Nazioni Unite e aziende di tecnologia globale che individuano i deepfake.

Per provare a riconoscere un deepfake, sarà sufficiente una semplice ricerca inversa delle immagini, efficace sia per i video che per le immagini stesse, per verificare i filmati/fotografie inviati. Questo processo abbastanza semplice consente di scoprire da dove provengono le immagini/i video e dove altro sono stati utilizzati (o forse plagiati). Questa è una delle forme più basilari di analisi forense digitale che può essere utilizzata per controllare rapidamente la veridicità dei contenuti.

Leggendo il documento di ricerca di Farid del novembre 2022, ” Proteggere i leader mondiali contro i deepfake“, pubblicato negli Atti dell’Accademia nazionale delle scienze degli Stati Uniti d’America, Farid menziona un esempio particolarmente convincente del comico e regista Jordan Peele. È un video modificato dei numerosi discorsi presidenziali di Obama in cui l’audio è stato alterato, con le labbra sincronizzate per corrispondere.

La soluzione adeguata per il futuro è una combinazione di strumenti forensi digitali e impronte digitali per contrassegnare i contenuti originali. Nel frattempo, il modo migliore per evitare di farsi ingannare è usare le proprie capacità critiche. Se qualcosa sembra strano, probabilmente lo è.